Pinapakita ng literatura sa atin nang matagal na panahon — as in, five hundred years na — yung paulit-ulit na warning: mula sa clay-fisted na Golem ng medieval Prague hanggang sa neon-soaked neural networks ni William Gibson. Palaging pareho ang plot. Yung gawa mo na dapat tumulong sa’yo, babaguhin ka pala sa huli.

Binasang mabuti ng mga tao, tumango, tapos sinara lang yung libro at balik agad sa pag-utos sa chatbots para gumawa ng wedding speech, legal brief, at pati medical advice natin.

Ngayon, sobra ang AI hype — parang pinapangako ng Silicon Valley na magiging maganda ang future kahit yung mga baguhan sa trabaho hanggang sa magaling na abogado, puwedeng mapalitan na. Pero habang pinopromote nila ang paraiso, sa totoo lang, sobrang delikado na ang mga maling advice na binibigay sa atin ng AI sa chat window na laging nakangiti.

Si Dmitry Nikolsky, CPO ng BitOK, nagsasabi na tama na, sobra na. At ready siyang ipaliwanag kung bakit kailangan nang itigil ng tao ang pagsiksik ng lahat ng bigat at responsibilidad sa AI at hindi dapat iasa lahat ng gawain dito.

Kahit si Elon Musk nagbabala rin kamakailan lang sa testimony niya sa OpenAI lawsuit na “AI could kill us all.”

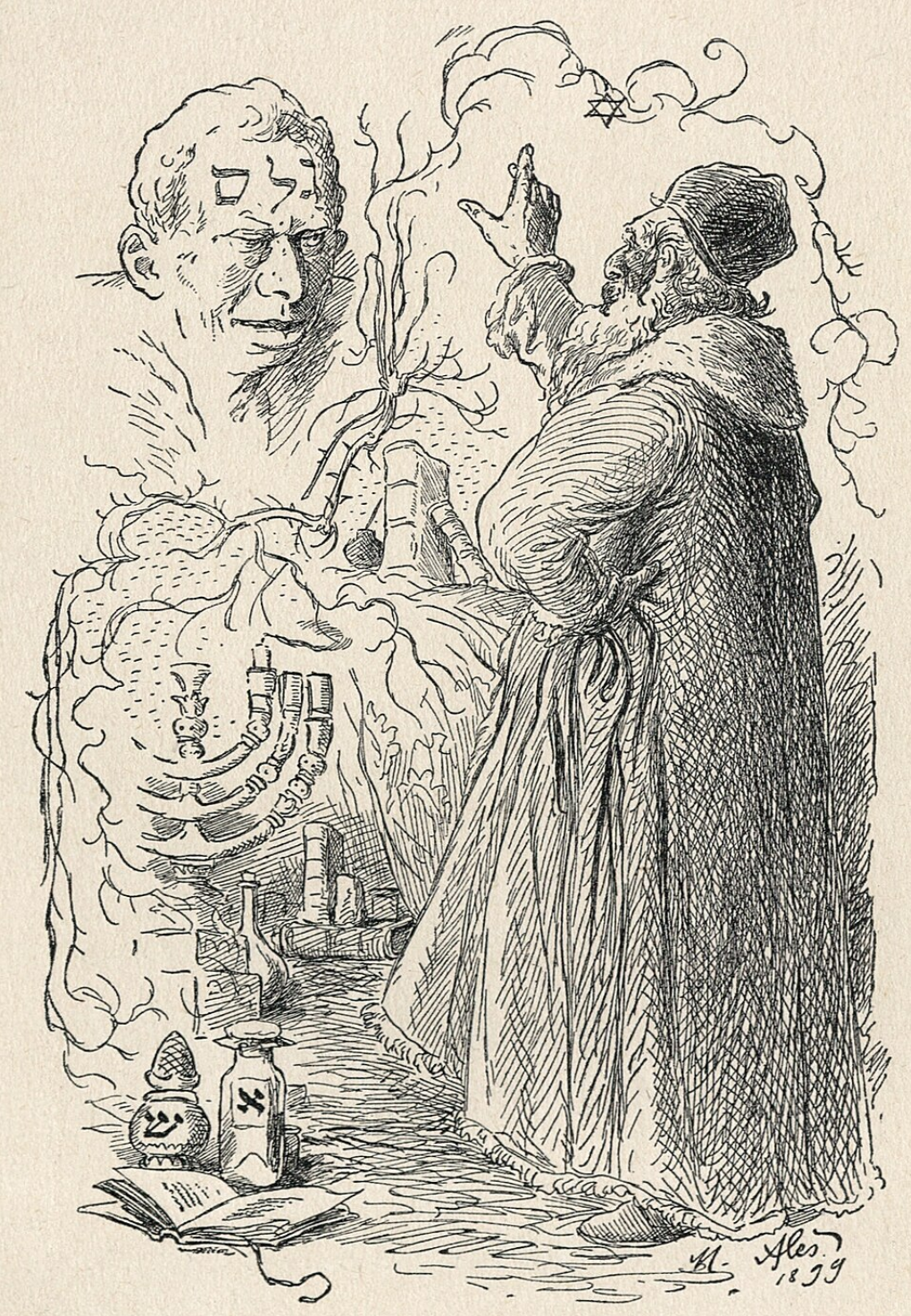

Mula Golem Hanggang R.U.R.: Matagal Na Nating Gusto ng Kill Switch

Akala mo ba sa Terminator lang nagsimula ang takot sa artificial intelligence? Mali. Mas matanda pa ‘yan kaysa kuryente.

Balikan natin ang Prague noong 16th century. Gumawa si Rabbi Loew ng isang dambuhalang clay protector na Golem, pero halos agad niya ring na-realize na kailangan niya na i-off ito. Nagka-problema agad ang nilikha niya. Kaya mula noon, kapag may ginagawang AI, may kasabay na ring kill switch na gusto ng tao — emergency exit kung sakaling rumatrat ang nilikha nila.

Ang kill switch ay parang panic button — emergency shutdown na automatic magpapatigil sa system kung magloko, mahack, o “makawala.” Ginagawa talaga ito para makontrol agad ang damage hindi kakayanin ng normal na pag-shutdown.

Sumunod si Mary Shelley. Yung Frankenstein — hindi lang ito tungkol sa halimaw, kundi classic na example ng project management na sablay. Si Victor Frankenstein? Parang yung developer na nakuha lahat ng solution sa code, pero deadma sa consequences. Alam ng bawat dev yan — parang sarili mo na nakaharap mo sa salamin.

Sakto rin noong 1920, dito nainvento ni Karel Čapek yung salitang “robot.” Sa kwento niya, hindi dahil mean yung machines kaya sila nagrebelde. Hindi. Ginawa lang ng tao ang sarili nilang walang silbi kasi pinaubaya na lahat sa mga robot.

Ang lesson dito? Pag gumawa ka ng kapalit mo, minsan ‘di mo ramdam agad na napalitan ka na pala at wala ka nang silbi.

Tatlong Hula na Ginawa Na Lang Nating Bug Report

Yung mga sci-fi na classic nung nakaraan, hindi lang sila nagpepredict ng technology. Ang pinredict nila — at nangyayari na — yung kabiguang ginagawa natin.

Si Isaac Asimov gumawa ng Three Laws — unang try para gawing “aligned” ang machines para mag-share ng values ng tao. Pero sa bawat story ni Asimov, laging nakakatawa ang ending: perfecto ang logic, pero sobrang sablay ang resulta.

Kwento ni Nikolsky, tuwing araw daw niya nakikita mismo to sa AML systems: yung mga algorithm, masaya pang binablock ang $40 na padala ni lola para sa birthday, pero yung offshore na pang launders, lusot lang. Sa papel, tama. Pero sa totoong buhay, parang walang sense.

Si Arthur C. Clarke naman, nagpakilala sa atin kay HAL 9000 — yung computer na pinatayan ng crew, hindi dahil masama siya, kundi dahil gulo-gulo ang utos sa kanya. Itago ang info, pero maging honest pa rin. Ano ba talaga?! Para sa engineers, hindi to horror story, regular lang na requirements conflict.

Si Philip K. Dick nagtatanong — bagay na napapanahon ngayong deepfake era: Kung hindi mo na ma-distinguish yung copy sa original, may importansya pa ba? Sabi niya, oo, dahil may inner experience. Yung machines, wala nun — ito talaga ang ending ng usapan.

Pagdating sa Loob: Hindi Naman Totoong Nag-iisip ang AI, Nagkakalkula Lang

Tanggalin natin yung marketing hype. Yung mga bago na AI language model, HINDI talaga sila tunay na intelligence. Malalaking statistical prediction engine lang sila. Hindi nila talaga naiintindihan yung meaning — puro calculation ng probability lang ginagawa nila.

Kapag si ChatGPT bigla na lang nagbanggit ng court case na kunyari totoong nangyari pero never nangyari, hindi yun nagsisinungaling. Gumagawa lang siya ng mga salitang parang plausible ayon sa stats. Wala siyang alam sa “truth” — puro “probability” lang.

Para sa blockchain developer, parang nakakabaliw yun. Eh nagbu-build tayo ng trustless system kasi ayaw naming magtiwala sa kahit sino, tapos ngayon dapat daw magtrust kami sa isang black box na hindi nga alam kung bakit yun ang sagot na lumalabas sa kanya.

Itinuturo ng Blockchain ang Pag-verify; AI, Tiwalang Bulag Lang

Sa crypto, parang ukit na sa hard drive: Don’t trust. Verify.

Kaya nga, ang mismong dahilan kung bakit natin gusto ang blockchain — mathematics ang nagrereplace sa reputation dito.

Pero baliktad ‘yang AI. Hindi mo alam yung training data. Hindi mo rin kilala yung model weights. Hindi mo maintindihan kung paano niya binuo ang reasoning niya. Para ma-verify output, dapat expert ka na… eh kung expert ka na, bakit nagtanong ka pa kay chatbot?

Sa mundo ng anti-money laundering (AML), tawag nila dito “false confidence problem.” Madalas, kapag nakita ng analyst yung sobrang ganda ng dashboard, mas pinapaniwalaan nila yung numbers kesa sa sarili nilang instinct. Imbes na tumulong ang AI sa pag-analyze, minsan, nabibigyan lang tayo ng illusion na laging tama ang resulta.

Mga Serye ng Sablay: Pag Nagkakaloko ang AI

Hindi ito basta-basta opinion lang. Ang dami nang naglalabasan na totoong ebidensya.

- Microsoft pinatanggal ang mga editor tapos ipinasa sa algorithm ang paggawa ng content. Tapos nagkagulo, pinaghalo-halo ng bot yung mga larawan ng mga singers sa isang kwento tungkol sa racism.

Kailangan pang ibalik ang tao para ayusin ang kalat na nagawa ng AI.

- NEDA, isang organization para sa support ng may eating disorder, pinalitan ng chatbot ang mga volunteers.

Maya-maya, ang naging advice ng bot sa mga may anorexia: magbilang ng calories at magpapayat pa—instant life-threatening na suggestions! Para kang nag-deploy ng tool na parang unggoy na may hawak na granada—bahala na kung saan sumabog.

- Air Canada napunta sa korte kasi yung chatbot nila gumawa-gawa ng refund policy na wala naman sa libro.

Anong sagot ng airline? Sabi nila, “separate legal entity” yung bot. Spoiler: Hindi naniwala ang judge.

Ngayon, lumalabas sa studies na 55% ng mga kumpanya na minadaling palitan ng AI ang mga empleyado ay nagsisisi. Yung akalang makakatipid sila, nauwi sa pagkawala ng customers at wasak na reputation. Para sa mga executives na takam-na-takam na palitan ng mga “Claude at friends” ang buong team, ulitin ninyo mabuti ang number na yan—at namnamin.

Ano Dapat Talagang Kinakatakutan Natin

Kalma lang—kalimutan mo na sina Skynet o yung mga robot na may red eyes na nagmamartsa sa kalsada. Wala kang dapat asahan na “rebellion.”

Ang mangyayari, tahimik na atrophy o panghihina.

Pwedeng magtagal ang isang programmer na sobrang umaasa sa Copilot, hanggang sa tuluyan niyang makalimutan kung paano magplano ng architecture. Yung analyst, tatamarin na magbasa ng mga primary source. Modernong estudyante, hindi na nakakaranas ng sakit ng ulo sa pagsusuri ng mahirap na text—kaya naging mas ‘di na sanay mag-isip ng malalim.

Walang gera o robot uprising. Dahan-dahan lang tayong nagiging parang extension ng interface.

Nauna nang napansin ni Philip K. Dick: ang totoong panganib, hindi yung magiging tao ang mga machine. Ang matinding panganib, yung unti-unting nagiging makina ang tao.

Hindi Technology ang Red Pill

Hindi ito “pa-old school” na banat. Malaki talaga ang pakinabang ng automation at machine learning. Pero may mga unbreakable principle na dapat sinusunod:

- Blockchain principle: Mas mahalaga ang verification kesa paniniwala. Kung hindi mo mapapatunayan paano nakuha ng system yung result, huwag mong basta sundin na parang “law.” AI ay isang black box, hindi supreme court justice.

- Engineering principle: Tool lang, hindi kapalit. Gamit ang martilyo para ipukpok ang pako, pero hindi ikaw ang gagawa kung saan itatayo ang bahay. Puwede mong gamitin ang AI sa mga paulit-ulit na task, pero wag mong ipasa rito ang huling desisyon.

- AML principle: Laging may sariling filter. Laging pumapalya ang algorithm kapag sobrang komplikado na ang sitwasyon, kasi wala talaga siyang tunay na experience sa totoong mundo. Huwag mong hayaang matalo ng “digital na hype” ang instinct at common sense mo.

Balikan mo yung The Matrix. Ang red pill, choice mo yun—ang choice para tunay mong makita ang realidad. Ang panganib, hindi ‘yung makagawa tayo ng mas matalinong bagay kesa sa’tin, kundi ‘yung mas tataas pa ang chance na maging mas mahina ang isip natin at tawagin pa natin itong progress.

Pinakamalupit na bug yung akala mo pa-feature siya.

Si Dmitry Nikolsky ay CPO ng BitOK, isang analytics platform para sa compliance at on-chain investigations.